Jak rozwój technologii serwerowych wpływa na wydajność hostingu

Dynamiczny rozwój technologii serwerowych determinuje jakość i stabilność usług hostingowych. W miarę jak zapotrzebowanie na szybkie i niezawodne strony internetowe rośnie, dostawcy hostingu wprowadzają innowacje na poziomie sprzętowym i programowym. Dzięki temu można zapewnić użytkownikom natychmiastowy dostęp do treści oraz minimalizować przestoje.

Nowoczesne rozwiązania sprzętowe a szybkość działania serwerów

W ostatnich latach obserwuje się znaczący wzrost wydajności centrów danych dzięki zastosowaniu zaawansowanych komponentów, takich jak procesory AMD EPYC czy Intel Xeon najnowszej generacji. Zwiększona liczba rdzeni oraz usprawnione mechanizmy zarządzania energią przekładają się bezpośrednio na szybsze przetwarzanie zapytań HTTP i obsługę większej liczby jednoczesnych połączeń.

Kluczową rolę odgrywają również nośniki danych. Tradycyjne dyski SSD ustępują miejsca serwerom NVMe, oferującym wielokrotnie wyższe prędkości odczytu i zapisu. W połączeniu z technologią PCIe Gen4 pozwala to na błyskawiczne odczytywanie baz danych oraz przyspieszenie procesu ładowania plików multimedialnych.

W ramach oferty hostido.pl dostępne są plany hostingowe oparte na nowoczesnych jednostkach pamięci masowej i procesorach wielordzeniowych, co zapewnia znacznie krótsze czasy odpowiedzi serwera i większą wydajność serwisów internetowych.

Optymalizacja oprogramowania serwerowego i jej znaczenie dla wydajności

Oprogramowanie serwerowe to nie tylko systemy operacyjne, ale też rozwiązania do obsługi baz danych, serwery WWW oraz silniki cache. Dzięki optymalizacji konfiguracji Apache, Nginx czy LiteSpeed możliwe jest zwiększenie liczby obsługiwanych jednoczesnych zapytań oraz redukcja czasu odpowiedzi.

Inwestycja w lekkie mechanizmy buforowania, takie jak Redis czy Memcached, pozwala na przechowywanie najczęściej wykorzystywanych danych w pamięci RAM, co znacząco redukuje obciążenie dysków oraz przyspiesza dostęp do kluczowych informacji. Równocześnie regularna aktualizacja oprogramowania serwerowego eliminuje luki bezpieczeństwa i usprawnia działanie usług.

Dodatkowe korzyści przynoszą narzędzia do analizowania obciążenia serwera, na przykład New Relic czy Prometheus. Dzięki nim administratorzy mogą monitorować parametry w czasie rzeczywistym i natychmiast reagować na anomalie, utrzymując wysoką jakość usług.

Rola chmury obliczeniowej w zwiększaniu dostępności usług hostingowych

Chmura obliczeniowa to rewolucja w dostarczaniu zasobów IT. Model IaaS umożliwia elastyczne przydzielanie mocy obliczeniowej i przestrzeni dyskowej zgodnie z bieżącym zapotrzebowaniem, co przekłada się na optymalizację kosztów. Klienci nie muszą inwestować w drogi sprzęt – wystarczy wykupienie określonego pakietu w chmurze.

Dzięki mechanizmom rozproszonego przechowywania i automatycznego skalowania możliwe jest zachowanie ciągłej dostępności serwisów, nawet w przypadku awarii pojedynczego węzła. Platformy takie jak AWS, Google Cloud czy Microsoft Azure oferują zaawansowane narzędzia zarządzania bezpieczeństwem oraz certyfikaty zgodności, co jest istotne dla firm prowadzących działalność wrażliwą na przestoje.

W praktyce klienci uzyskują środowisko o wysokiej elastyczności, gdzie dodawanie zasobów następuje w czasie rzeczywistym, a fakturowanie opiera się wyłącznie na rzeczywistym zużyciu – co sprzyja optymalizacji budżetu i skalowaniu projektów online.

Wpływ technologii wirtualizacji na elastyczność i skalowalność hostingu

Technologie wirtualizacji, takie jak KVM, VMware ESXi czy Hyper-V, pozwalają na tworzenie odizolowanych środowisk w obrębie jednego fizycznego serwera. Dzięki temu dostawcy hostingu mogą zaoferować klientom niezależne maszyny wirtualne (VPS), które działają jak samodzielne serwery.

Wirtualizacja przekłada się na efektywniejsze wykorzystanie zasobów sprzętowych – każdy węzeł obliczeniowy może udostępniać moc obliczeniową i pamięć wielu użytkownikom jednocześnie, przy zachowaniu zasad izolacji. Pozwala to na dynamiczne przenoszenie maszyn wirtualnych pomiędzy hostami bez przerw w działaniu usług.

Wdrożenie kontenerów, takich jak Docker czy Kubernetes, idzie o krok dalej, upraszczając proces wdrożenia oraz automatyzując skalowanie aplikacji. Dzięki temu można precyzyjniej dostosować ilość uruchomionych instancji do aktualnego obciążenia.

Znaczenie automatyzacji i monitoringu w zarządzaniu serwerami

Automatyzacja procesów administracyjnych znacząco redukuje ryzyko błędów ludzkich i przyspiesza wdrażanie zmian w konfiguracji. Narzędzia typu Ansible, Puppet czy Chef umożliwiają definiowanie infrastruktury jako kodu, co przekłada się na spójność środowisk deweloperskich i produkcyjnych.

Monitoring to podstawa utrzymania wysokiej jakości usług. Dzięki systemom takim jak Zabbix czy Grafana można na bieżąco analizować kluczowe metryki, takie jak obciążenie CPU, zużycie pamięci czy opóźnienia sieciowe. Wcześnie wykryte nieprawidłowości pozwalają na szybką interwencję i zapobiegają wydłużeniu czasów przestoju.

W wielu przypadkach wdrożenie kompleksowego systemu zarządzania obejmuje:

- Automatyczne powiadomienia o przekroczeniu progów alarmowych,

- Regularne wykonywanie kopii zapasowych zgodnie z harmonogramem,

- Testy obciążeniowe i symulacje awarii w środowisku testowym.

Trendy w rozwoju technologii serwerowych a przyszłość hostingu

Przyszłość hostingu wiąże się z dalszą miniaturyzacją komponentów oraz popularyzacją architektury edge computing. Rozproszone węzły przy granicach sieci pozwolą na dostarczanie treści z minimalnym opóźnieniem, co jest kluczowe dla aplikacji czasu rzeczywistego, takich jak streaming gier czy transmisje na żywo.

Równolegle rozwijają się technologie oparte na sztucznej inteligencji, które umożliwiają predykcyjne zarządzanie zasobami oraz automatyczną optymalizację zużycia energii. Inteligentne algorytmy będą w stanie dynamicznie dostosować parametry serwera do aktualnego zapotrzebowania, co przełoży się na niższe koszty operacyjne i mniejszy ślad węglowy centrów danych.

W nadchodzących latach warto śledzić także rozwój serwerów kwantowych i ich wpływ na bezpieczeństwo transmisji danych. Choć technologia ta jest jeszcze w fazie eksperymentalnej, może zrewolucjonizować mechanizmy szyfrowania i przechowywania informacji.

Ostatnie Artykuły

Nie żyje Łukasz Litewka - poseł Lewicy zginął w wypadku

Wojsko wraca do Płocka. Trzy decyzje zmieniają układ sił

Tysiące zgłoszeń i brak patrolu nie oznaczają spokoju na mazowieckich drogach

Sztuka poza mapą wraca do Płocka - dzień filmów w Przedwiośniu

Domy z desek, rysunki z pamięci - te filmy zostają pod skórą

Atom, poezja i kosmos - finał “Spójrz w niebo - STEAM-owy Kopernik

![[PIŁKA RĘCZNA] Handball Stal Mielec – Orlen Wisła Płock 23:35 w ORLEN Superlidze – pewny krok płocczan w ćwierćfinale](/images/mecz/thumbnails/handball-stal-mielec-orlen-wisla-plock-22042026-2335.webp)

[PIŁKA RĘCZNA] Handball Stal Mielec – Orlen Wisła Płock 23:35 w ORLEN Superlidze – pewny krok płocczan w ćwierćfinale

W Płocku rusza majowy szlak pamięci. Wraca biało-czerwony proporzec

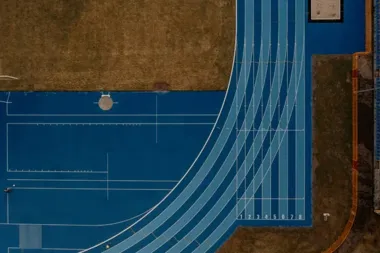

Stadion Miejski w Płocku daje trening, którego brakuje na asfalcie

Sekundy dzieliły 40-latka od tragedii na płockim moście

W Płockiej Galerii Sztuki kwiecień przynosi dwa spotkania ze sztuką

Trzech kierowców wpadło w jeden dzień - płocka SPEED nie odpuściła

Miejskie żłobki otwarte dla najmłodszych. Nabór trwa przez cały rok